2024/06/24セキュリティソリューション

ChatGPTが孕むセキュリティリスクとは?導入している企業が検討すべきセキュリティ対策

ChatGPTが孕むセキュリティリスクとは?導入している企業が検討すべきセキュリティ対策

執筆:CISO事業部 Momo. Y

監修:CISO事業部 吉田 卓史

昨今、ニュース・新聞・広告のいずれにおいても毎日1回は「ChatGPT」という単語が並んでおり、実際に利用したことがある方も多いのではないでしょうか。また、東証プライム企業の全1,834社のうち10%以上である186社が既にChatGPTを導入しているというデータも出ており、ChatGPTの活用が日々進んでいます。[1] しかし、ChatGPTを導入した企業が機密情報を漏洩したというインシデントも既に発生しています。この記事では、ChatGPT利用におけるセキュリティリスクとその対策についてご紹介していきます。

AI、生成AI、機械学習、ディープラーニングとは

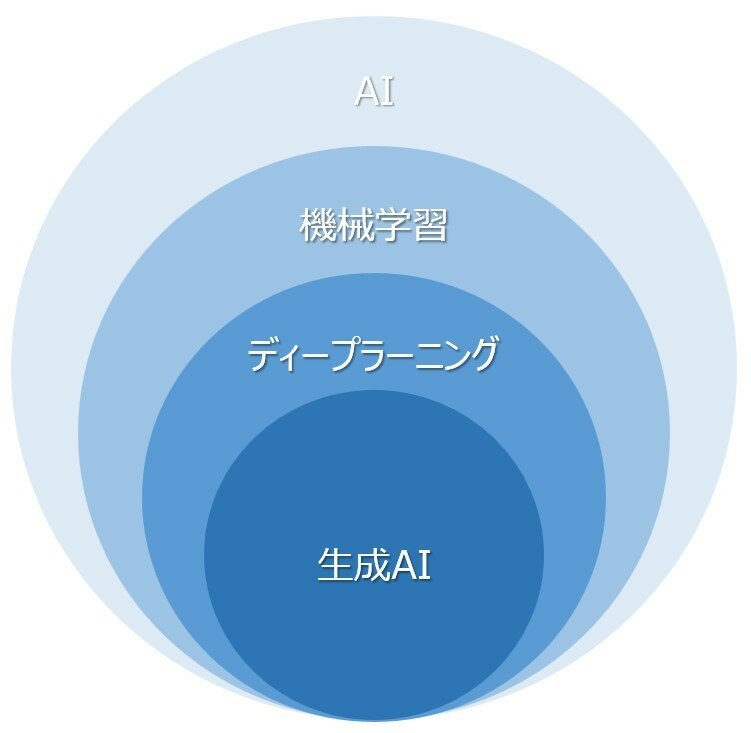

ChatGPTは生成AIに分類されますが、生成AI、AI、機械学習、ディープラーニングとはそれぞれどのような関係性を有しているのでしょうか。図1にてそれぞれの関係を示しています。AIは人工知能を表し、人間の脳が行っている知能的な活動をコンピューターで実現しようとする技術のことを指します。AIの知能を向上させるために必要な過程として、大量のデータをAIに読み込ませパターンや規則を学習させることで、その学習内容をもとに予測や判断を行うというAI技術の1つが機械学習です。そして、その機械学習をさらに発展させたものがディープラーニングであり、分析時に指示をしなくとも自分で共通点を探し出すことができる、人間の神経細胞の仕組みに似ている技術です。生成AIはディープランニングを活用し、入力された指示情報にもとづき、テキストや画像などのコンテンツをオリジナルで生み出すことを可能にする技術となります。

図1. AI、機械学習、ディープラーニング、生成AIの関係 [2]

生成AIで実現できることとは

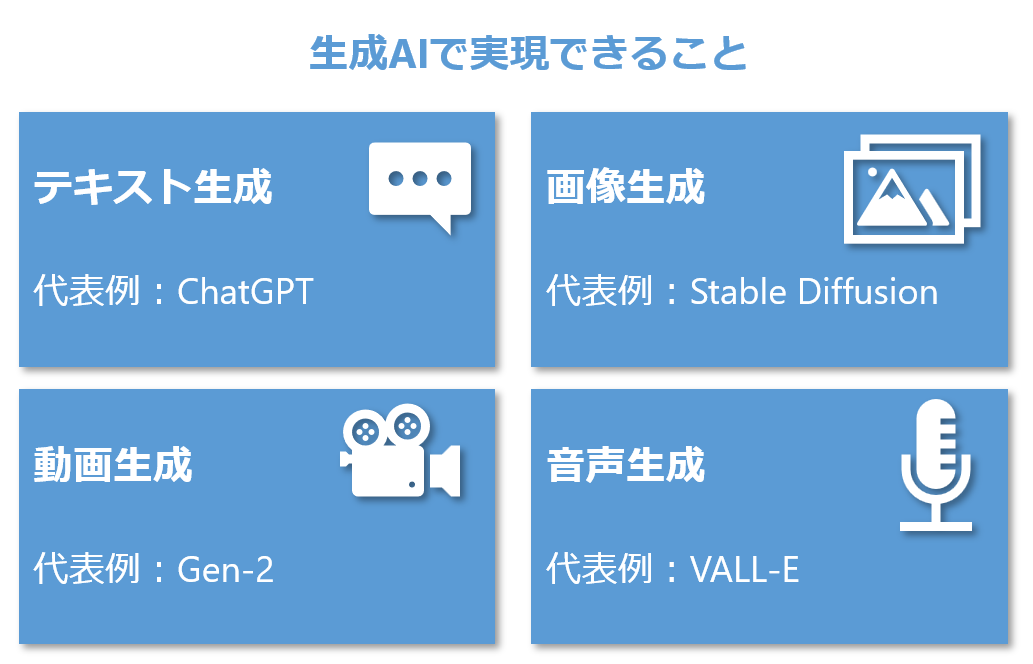

図2のように、生成AIは大きく分けて4種類あり、ユーザーが指示した内容に基づき、テキスト、画像、動画、音声のオリジナルコンテンツを生成します。生成AIが誕生するまでは、人間が自分の手を動かしてコンテンツを創り出す必要がありましたが、生成AIを用いれば、自分が欲しいコンテンツのイメージをテキストに入力するだけで自動生成できます。今までは技能と労力、時間をかけて、自力でコンテンツを作成する必要がありましたが、生成AIの登場によって、コンテンツ作成未経験者も気軽にオリジナルコンテンツを作成できるようになりました。このように、生成AIがもたらした技術は画期的であり、これからの未来においても重要な技術であると言えるでしょう。

図2. 生成AIで実現できること

生成AIであるChatGPT利用におけるセキュリティリスク

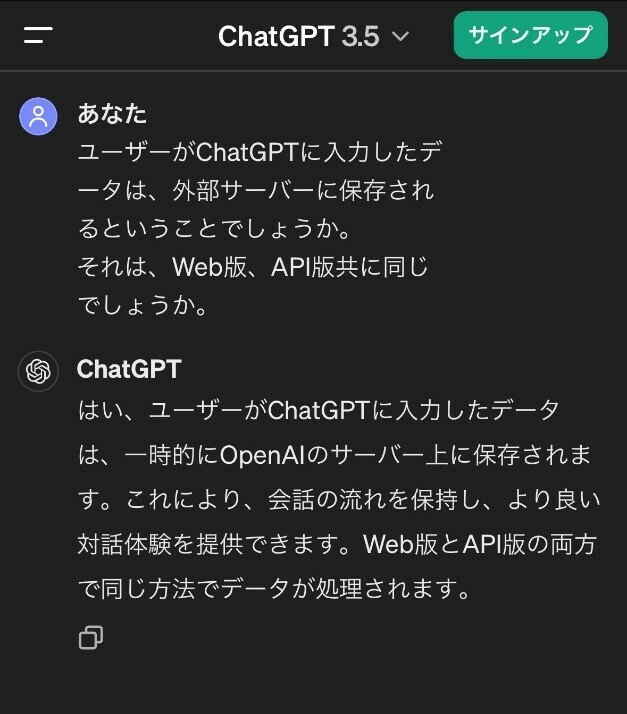

ChatGPTは非常に画期的な技術ではありますが、「情報漏洩」というセキュリティリスクを常に抱えています。図3のように、生成AIプラットフォームであるChatGPTに送信したデータはWeb版・API版ともに外部サーバーに保存されてしまうため、後に回収や完全削除を行うことは難しく、ChatGPTに機密情報を送信していた場合は、意図せず機密情報が外部へ漏洩していることと同義になりますので、使用時に注意が必要です。さらに、Web版を使用すると、入力したデータが他ユーザーの回答へと使用されてしまう可能性があるというリスクも抱えています。

インシデント事例としては、2023年3月30日に、Samsung ElectronicsにてChatGPT社内利用により3件の機密情報の漏洩が発生しました。3件の内訳としては、ソフトに関するエラーを解消するためにソースコードをChatGPTに入力したというものが1件、プログラムに関するソースコードをChatGPTに入力したというものが1件、社内会議の録音データを文書ファイルにしたものをChatGPTに入力したというものが1件となっております。 [3]

他の事例としては、ChatGPTのバグによって、一部のユーザーに他のユーザーのチャット履歴のタイトルが表示されるということも発生したことがあります。[4]

インシデント事例として2件を挙げさせていただきましたが、先述したように、ユーザーが開発中のシステムのソースコードや顧客情報、企画書などの企業の機密情報をChatGPTに送信した場合、データが外部サーバーに保存されてしまうため、データが送信されてしまった時点で情報漏洩となります。もし、社員がこのようなリスクを全く気にせずにChatGPTを利用している場合、いつ会社の機密情報を悪気なく送信してしまい情報漏洩となってしまってもおかしくはありません。

しかし、そういった情報漏洩のリスクがあったとしても、企業としてChatGPTの利用を止めることは難しいという場合もあるかと思います。その場合、どのようなセキュリティ対策を取るべきでしょうか。

図3. ChatGPT Web版・API版における入力データの保存先

図3. ChatGPT Web版・API版における入力データの保存先

ChatGPT利用におけるセキュリティ対策

DLP (Data Loss Prevention)の導入

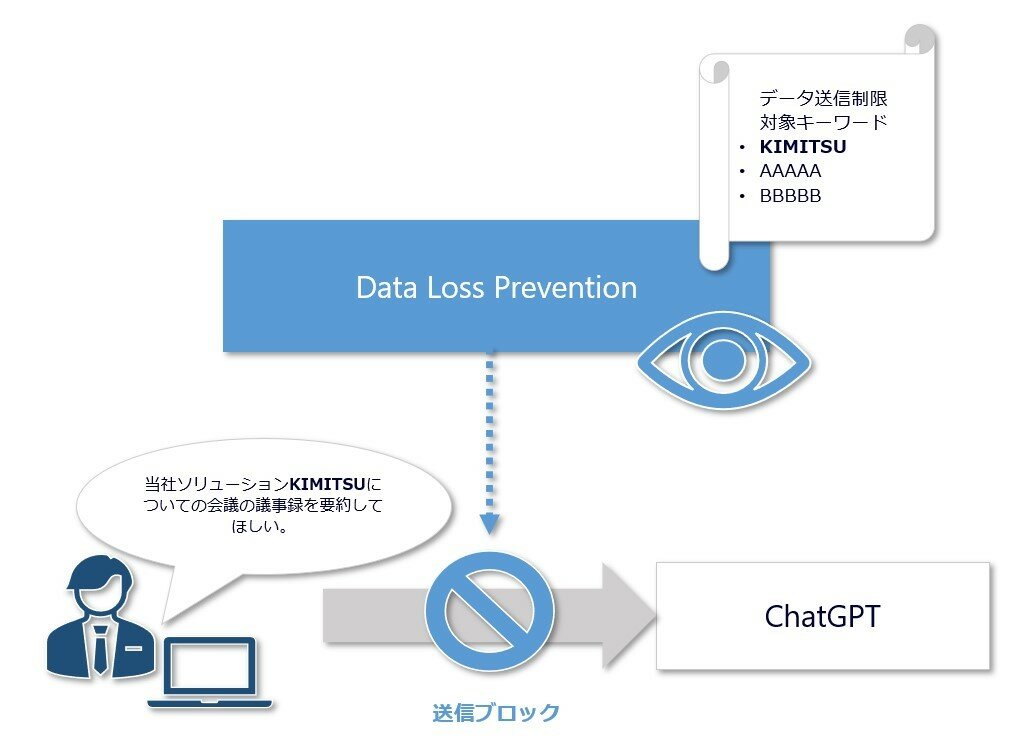

DLPの導入が、ChatGPT利用における情報漏洩を防ぐにあたって有用と言えます。DLPとは、企業が保有する情報の漏洩を防ぐためのシステムを指し、常にデータを監視し、あらかじめ設定した条件に該当するデータの送信をブロックする機能を持っています。図4のように、事前に指定の条件として、機密情報に関するキーワードを登録しておくことで、社員が機密情報を含んだテキストを誤ってChatGPTのプロンプトに入力してしまっても、送信をブロックすることができ、情報漏洩を防ぐことが可能です。

図4. DLPの仕組み

利用者を制限し、CASB機能を用いて利用者以外のアクセスを遮断する

情報漏洩を防ぐにあたって、CASBの機能を用いてChatGPTの利用者を制限し、利用者以外のChatGPTへのアクセスを遮断するという方法も有用です。CASBの機能としては、クラウドサービスへのアクセスの可視化や監視、制御が挙げられます。会社が管理しているクラウドサービスやアプリケーションにおいて、ユーザーのアクセス権限や実行内容を制御でき、また、同機能を用いることで、該当者に対するChatGPTへのアクセス遮断が可能です。ChatGPT利用における便利さとのトレードオフにはなりますが、利用者を制限してリスクを削減することもセキュリティ対策として有効な手段です。

ソリューションによる解決

前述のDLP、CASBを実装するソリューション例として、Zscalerが挙げられます。ZscalerのZIA(Zscaler Internet Access)を用いることで、従業員が利用しているデバイスからのインターネットトラフィックを一元的に管理および多層防御でき、CASBとDLPを実装することが可能です。

ZIAを用いてCASBを実装し、ポリシーを設定することで、該当者のChatGPTへのアクセスをブロックでき、利用者以外のChatGPTへのアクセス遮断が可能となります。

また、CASBと同様にZIAを用いることでDLPを実装でき、事前に指定の条件を設定しておくことで、利用者が誤ってChatGPTへ機密情報をアップロードしようとしても、その送信をブロックし、機密情報の送信を阻止します。また、違反が発生した旨のメール通知を運用者へ送信することも可能です。

弊社ではZscalerの導入・運用支援サービスを提供しており、多数の導入実績もございます。導入におけるご相談がありましたら、弊社にて最適な導入の進め方をご提案いたしますので、お気軽にお問い合わせくださいませ。

利用者に対して教育を行う

どのような入力は問題がないのか、機密情報は絶対に入力してはならない、などのルールを企業で定めて文書としてまとめ、ChatGPT導入前に事前に利用者に対して教育を行うことが重要です。発生したことのあるインシデント事例の紹介や、インシデント発生時のエスカレーション方法についても説明を行うことがマストと言えます。弊社におきましても、セキュリティ教育サービスを展開しております。

まとめ

新しいシステムやツールを導入する際は必ずセキュリティ対策を合わせて考慮することが必須と言えます。セキュリティ対策を後回しにしてしまうと、企業が保有している重要な開発情報や顧客情報などの機密情報漏洩がいつ発生してもおかしくはないでしょう。画期的な技術であるChatGPTを安全に、かつ効果的に利用するためにも、企業はDLPなどのセキュリティ対策を積極的に導入することが重要であると思います。どのソリューションのDLPを導入すればよいか分からない、セキュリティ教育の進め方が知りたい、といったご相談がありましたら、弊社にて最適な戦略・ソリューションをご提案いたしますので、お気軽にお問い合わせくださいませ。

【参考文献】

[1] "東証プライムに上場する1834社に対してChatGPT導入実態調査を実施!金融、サービス業を中心に積極的に活用が進む!." AIsmiley. (2023, October 17). https://aismiley.co.jp/ai_news/chatgpt-investigationresult/

[2] "生成AI(ジェネレーティブAI)とは?ChatGPTとの違いや仕組み・種類・活用事例." DOORS DX. (2024, May 16). https://www.brainpad.co.jp/doors/contents/about_generative_ai/

[3] "samsung、chatgptの社内利用で3件の機密漏洩." PC Watch. (2023, April 4). https://pc.watch.impress.co.jp/docs/news/yajiuma/1490904.html

[4] "Chatgptで情報漏洩は起こる?対策や履歴オフの設定方法を解説:コラム Malion|インターコム." MaLion. (n.d.). https://www.intercom.co.jp/malion/column/chatgpt-information-leakage/

[5] "Zscalerとは?セキュリティをクラウドで実現するしくみとその安全性. ネットワークのトータルソリューション:エイチ・シー・ネットワークス株式会社." (n.d.). https://www.hcnet.co.jp/column/detail25.html

【プロフィール】

文責:Momo. Y

2022年にアイディルートコンサルティング株式会社(IDR)の前身であるデジタルアーツコンサルティング株式会社に新卒で入社。

セキュリティ領域におけるコンサルティング支援に携わっており、大手システムインテグレーターのプロジェクトにおいて、海外支社と連携した最新テクノロジーの発掘、PoC実行支援や、セキュリティ製品のグローバル展開支援、グローバルでの戦略立案・実行支援などを担う。

監修:吉田 卓史(よしだ たくし)

20年間にわたり、一貫してサイバーセキュリティーに携わる。ガバナンス構築支援からセキュリティ監査、ソリューション導入等、上流から下流まで幅広い経験を有する。また、複数の企業において、セキュリティのコンサルティングチーム立ち上げを0から担い、数億円の売上規模にまで成長させる。IDRにおいても、セキュリティコンサルティングチームの立ち上げを担い、急速なチーム組成、案件受注拡大を行っている。